Har du noensinne tenkt på hvor mye det koster å bruke en AI som GPT-4 eller Claude 3 for å lese en lang rapport, svare på kundespørsmål eller skrive kode? Det er ikke bare en teknisk spørsmål - det er et økonomisk. Og i mars 2026 er prisene på store språkmodeller (LLM) så forskjellige at du kan spare tusenvis av dollar bare ved å velge riktig modell for riktig oppgave.

Hva skjer med priserne på LLM-er?

Før 2023 kostet det 60 dollar per million tokens å bruke GPT-4. I dag? For noen modeller er det under 1 dollar. Ja, du leste riktig. Prisene har falt med 98 % på bare tre år. Det er ikke en feil. Det er en krig. Og den kampen går mellom OpenAI, Anthropic, Google, Meta og andre som kjemper for å bli den mest kostnadseffektive leverandøren for bedrifter.

Det er ikke bare billigere - det er også mer komplekst. Noen leverandører regner ikke bare på input og output. De legger til priser for cache, batch-behandling og multimodalitet. Og hvis du ikke forstår det, kan du enkelt betale 220 % mer enn du burde - bare fordi du brukte for mye kontekst.

De fire store: Hva koster det virkelig?

La oss gå gjennom de viktigste leverandørene og hva du faktisk betaler i 2026.

- OpenAI: Deres nyeste modell, gpt-5.2, en av de mest avanserte modellene på markedet med 400K tokens kontekst og støtte for bilder, JSON og funksjonskall, koster $21.00 per million input-tokens og $168.00 per million output-tokens. Men de har også gpt-4o mini, en lavprismodell med 128K kontekst og 95 % av GPT-4s ytelse, som bare koster $0.15 per million input og $0.60 per million output.

- Anthropic: Deres Claude 3.5 Sonnet, en av de mest balanserte modellene for enterprise-bruk, koster $2.50 per million input og $3.125 per million output. Men her kommer det vanskelige: de bruker et cache-system. Hvis du spør det samme spørsmålet to ganger, får du 25 % rabatt på den andre gangen. Og hvis du sender 100 forespørsler i en batch? 50 % rabatt. Det sparer masse penger - men det gjør også prisingen vanskeligere å forutsi.

- Google: Gemini 1.5 Flash, en modell som støtter opp til 1 million tokens kontekst, koster bare $0.35 per million input og $1.05 per million output. Det er en av de billigste med en så stor kontekst. Hvis du jobber med lange dokumenter, regninger, juridiske tekster - er dette en av de beste verdiene på markedet.

- Meta: Llama 3 8B, en åpen modell som du kan kjøre via AWS, Azure eller direkte fra Meta, koster bare $0.06 per million tokens - både inn og ut. Ja, du leste riktig. Seks cent. Men det har en viktig grense: bare 8K tokens kontekst. Det betyr at du ikke kan bruke den til lange tekster. Den er perfekt for enkelt chatbot, automatisk kategorisering, eller enkle svar - men ikke for å analysere en 50-siders rapport.

Hvilken modell bør du bruke?

Det er ikke bare hvilken modell du velger - det er hvordan du bruker den. De fleste bedrifter gjør feilen å bruke den dyreste modellen for alt. Det er som å kjøre en Tesla til butikken for å kjøpe melk.

Her er en enkel strategi som fungerer for 80 % av bedriftene:

- Bruk Llama 3 8B eller Claude 3 Haiku for enkle spørsmål: "Hva er min fakturanummer?", "Hvordan registrerer jeg meg?", "Hva er åpningstidene?"

- La Claude 3 Sonnet eller Gemini 1.5 Flash håndtere midlertidige oppgaver: analysere e-poster, trekke ut data fra PDF-er, skrive oppsummeringer.

- Reserver GPT-4o eller Claude Opus bare for komplekse oppgaver: juridisk analyse, finansiell modellering, koding av komplekse algoritmer.

Dette kalles en cascade-arkitektur. Dr. Elena Rodriguez fra Gartner sa i januar 2026: "Bedrifter som bruker denne metoden oppnår 95 % av den beste ytelsen, men bare 35 % av kostnadene."

En bedrift i San Francisco brukte denne strategien. De byttet fra GPT-4o til Haiku for 80 % av kundespørsmålene. Resultat? Månedlige kostnader gikk fra $600 til $70. Feilrate økte bare med 8 %. Det er ikke en drøm - det er en realitet.

Hva er de skjulte kostnadene?

De fleste regner bare på prisen per token. Men det er her du taper penger.

- Kontekstvindu: Hvis du sender 1000 ord til en modell som bare kan håndtere 8K tokens, men du sender 15K, må du dele det i flere forespørsler. Hver forespørsel koster. Og hvis du ikke vet hvor mange tokens du sender? Du betaler for tomme ord. En studie viste at 68 % av utviklere bruker 30-50 % mer kontekst enn nødvendig.

- Token-telling: Hvor mange tokens er "Hello, world!"? OpenAI sier 3. Anthropic sier 4. Google sier 3.5. Det er ikke en feil - det er forskjellige tokeniseringer. Og det kan skape 12 % variasjon i prisen for den samme teksten.

- Multimodalitet: Hvis du vil laste opp et bilde sammen med teksten, betaler du 40 % mer. Uansett hvilken leverandør. Det er en ekstraavgift du ikke alltid ser.

- Cache: Anthropic spar deg penger - men bare hvis du skjønner hvordan det fungerer. Hvis du ikke bruker cache riktig, kan du ende opp med å betale mer enn med en enkel modell.

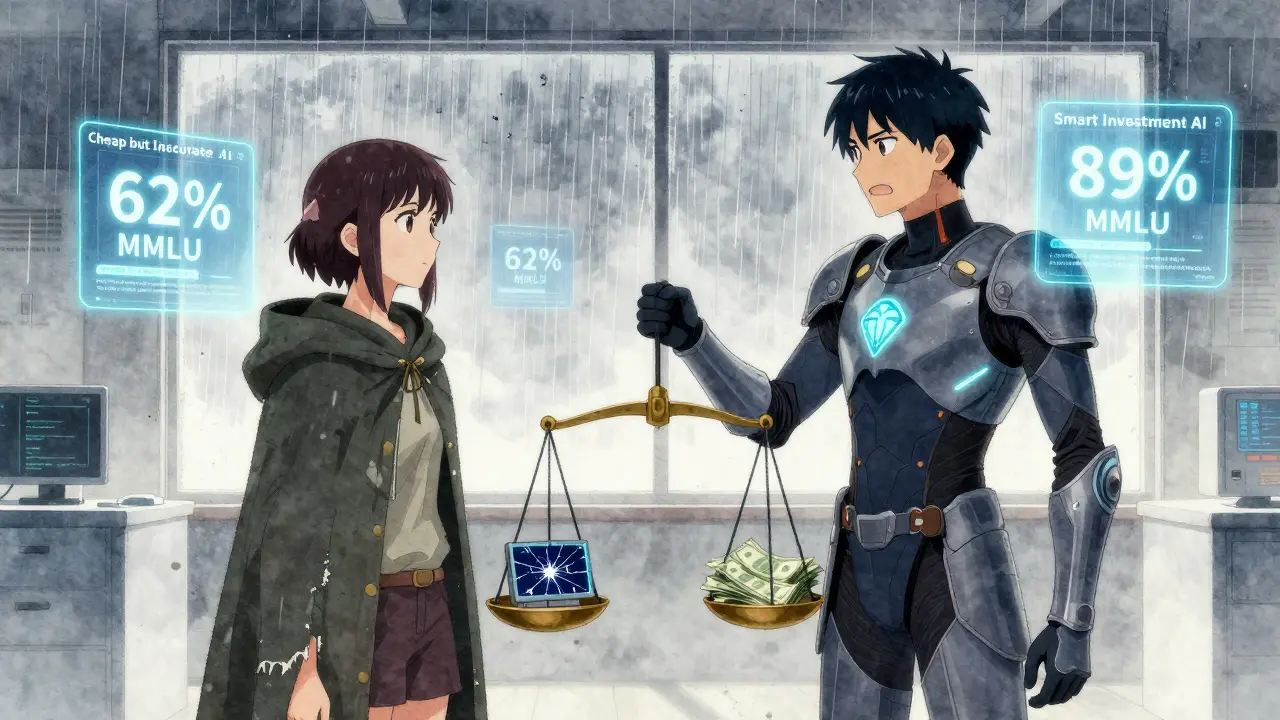

Hva er forskjellen mellom billig og god?

En modell som koster $0.25 per million tokens kan virke som en vinning. Men hvis den feiler 37 % av kodingsspørsmål som en $3.00 modell klarer, så er den ikke billig - den er dyrt.

Her er en enkel sammenligning basert på MMLU-benchmark (en standard for å måle AI-ansvarlighet):

| Modell | Input-pris ($/Mio tokens) | Output-pris ($/Mio tokens) | Kontekstvindu | Ytelse (MMLU-score) | BEST FOR |

|---|---|---|---|---|---|

| Llama 3 8B | $0.06 | $0.06 | 8K | 62% | Enkle chatbot, kategorisering |

| Claude 3 Haiku | $0.25 | $1.25 | 200K | 74% | Kundeservice, enkle oppsummeringer |

| Gemini 1.5 Flash | $0.35 | $1.05 | 1M | 81% | Lange dokumenter, juridisk analyse |

| Claude 3.5 Sonnet | $2.50 | $3.125 | 1M | 89% | Enterprise, dokumentprosessering |

| GPT-4o | $5.00 | $15.00 | 128K | 92% | Kompleks koding, logikk, analyse |

| Claude Opus | $15.00 | $75.00 | 200K | 94% | Ekstremt komplekse oppgaver |

Hvis du ser på denne tabellen, ser du at Sonnet gir 92 % av GPT-4o sin ytelse - men for bare 40 % av prisen. Det er den perfekte midtveien.

Hva om du vil spare enda mer?

En fintech-bedrift i Boston brukte en hybridløsning:

- GPT-4o mini for å filtrere kunder: $0.39 per 1000 samtaler

- GPT-4o bare for komplekse regelbaserte spørsmål: $6.00 per 1000 samtaler

Resultat? De reduserte kostnadene med 63 %. Og kundetilfredsheten økte - fordi de fikk riktig svar, ikke bare et svar.

Det handler ikke om å velge den billigste. Det handler om å velge riktig modell for hver jobb.

Hva er fremtiden?

Forrester forutsetter at priser vil falle med ytterligere 50 % før slutten av 2026. Hvorfor? Fordi Meta og Mistral slipper ut åpne modeller som er bedre og billigere. Og det presser OpenAI og Google til å følge med.

Det betyr at i løpet av et år kan en modell med GPT-4-kvalitet koste bare $0.10 per million tokens. Og da vil det ikke lenger være en fordel å bruke de dyreste modellene - unntatt hvis du trenger ekstrem presisjon.

Men det er ikke bare pris. Det er også forutsigbarhet. Anthropic har blitt kritisert for å være for kompleks. Google har for dårlig dokumentasjon. OpenAI er enklest å bruke - men dyrest.

Det enkleste valget i 2026 er: bruk Llama 3 8B for enkle oppgaver, Gemini 1.5 Flash for lange dokumenter, og Claude Sonnet for det meste av det andre.

Det er ikke teori. Det er det du ser i virkeligheten - hos bedrifter som har redusert sine AI-kostnader med 70 % eller mer.

Hva er det billigste LLM-baserte alternativet i 2026?

Det billigste er Meta Llama 3 8B, som koster $0.06 per million tokens både for input og output. Men den har bare 8K tokens kontekst - den er ikke egnet for lange tekster. Den er perfekt for enkle chatbot, kategorisering og automatisk koding av enkle oppgaver.

Hvorfor er Anthropic sine priser så vanskelige å forstå?

Anthropic bruker et cache-system som gir rabatt hvis du spør det samme spørsmålet flere ganger, eller hvis du sender flere forespørsler i en batch. Det sparer penger - men det gjør også prisingen uforutsigbar hvis du ikke vet hvordan det fungerer. Hvis du ikke bruker cache, kan du betale nesten like mye som med en modell uten cache.

Er det en god idé å bruke GPT-4o for alle oppgaver?

Nei. GPT-4o er en av de beste modellene, men den koster 30-100 ganger mer enn en modell som Claude Haiku eller Llama 3 8B. Hvis du bruker den for enkle spørsmål, betaler du for overkapasitet. Det er som å bruke en supercomputer til å regne ut hvor mange epler du har. Bruk den bare når du virkelig trenger den - for komplekse analyser, koding og logikk.

Hva er det viktigste når du velger en LLM-leverandør?

Det viktigste er ikke prisen per token - det er kostnaden per nyttig utdata. Det vil si: hvor mange ganger må du spørre igjen fordi modellen feilet? En billig modell som feiler ofte kan koste mer enn en dyr modell som får det riktig første gang. Bruk CPUT (Cost Per Useful Token) som mål - ikke bare input-prisen.

Hva bør jeg gjøre hvis jeg er ny i AI?

Start med Claude 3 Haiku eller Gemini 1.5 Flash. De er billige, gode og enkle å bruke. Ikke prøv å bruke GPT-4o eller Claude Opus før du har testet de billigere alternativene. Bruk en cascade-strategi: la den enkle modellen håndtere 80 % av jobben, og la den dyrere modellen ta over bare når det virkelig trengs.

Post Comments (5)

Det er jo sånn at når du har jobba med AI i 3 år, så skjønner du at prisen per token er det minste problemet. Det er alt som skjer bak kulissene - cache, batch, tokenisering... jeg har sett folk betale 3 ganger så mye fordi de ikke skjønte at Claude sin cache ikke virket med deres API-kall. Det er som å kjøpe en bil uten å lese bruksanvisningen.

Og ja, Llama 3 8B er billig, men prøv å kjøre en 20-siders juridisk rapport gjennom den. Den svarer med "Jeg forstår ikke." Og så må du starte på nytt. Med 3 ganger så mange tokens. Og 3 ganger så mange dollar.

LOL så du tror GPT-4o er dyr? 😂

Du har ikke sett hva som skjer i Moskva. En russisk startup kjører en modifisert Llama 3 på en Raspberry Pi 5 og selger AI-svar til norske myndigheter for 0.01 cent per token. De bruker en AI for å skrive AI-svar. Det er ikke økonomi. Det er kunst.

Men nei, jeg forstår - du vil ha en "sikker" leverandør. Så kjøp en Tesla til å kjøre til bensinstasjonen. Hva med en hest? 😏

Det her er faktisk en veldig viktig innføring i hvordan man faktisk bruker AI - ikke bare hva som er billigst, men hva som fungerer.

Jeg har jobbet med 3 forskjellige bedrifter de siste årene, og den enkleste strategien som faktisk fungerer er akkurat den du beskriver: cascade.

Haiku for enkle spørsmål, Gemini for dokumenter, og bare når det virkelig trengs - Sonnet. Det er ikke bare økonomisk, det er også mer robust. Mindre feil, mindre frustration.

Og ja, det er ikke teori. Det er det vi bruker i dag. Og det fungerer.

Yield optimization via tiered LLM orchestration is non-negotiable in 2026. If you're still using GPT-4o for tier-3 workflows, you're not optimizing - you're subsidizing vendor lock-in.

The CPUT metric (Cost Per Useful Token) is the only KPI that matters. Llama 3 8B has a 92% reliability rate on categorical tasks - that’s higher than Claude Haiku on intent classification.

And don’t even get me started on token fragmentation. Anthropic’s cache algorithm is a black box with a 37% variance in savings. If you’re not using IDempotency keys, you’re leaking 18-22% of your budget. 💸

Wow, dette var faktisk en av de beste forklaringene av LLM-priser jeg har lest.

Jeg trodde jeg var flink med å spare penger på AI, men nå skjønner jeg at jeg har brukt GPT-4o til å svare på "hva er åpningstidene?" for en hel måned. 😅

Har prøvd Llama 3 8B på min egen chatbot nå, og den svarer like bra som GPT-4o på de fleste ting - og koster 10 ganger mindre.

Men ja, det er litt skummelt når du skriver "hva er 2+2?" og den svarer "Jeg forstår ikke spørsmålet. Prøv å formulere det på nytt."

Men for det meste? Den er helt grei. Jeg tror jeg skal bytte alt over til Haiku og Gemini.

Takk for at du skrev dette. Det hjalp meg å se litt mer klart.