Tag: AI-kostnader

- March 15, 2026

- Comments 8

- Teknologi og kunstig intelligens

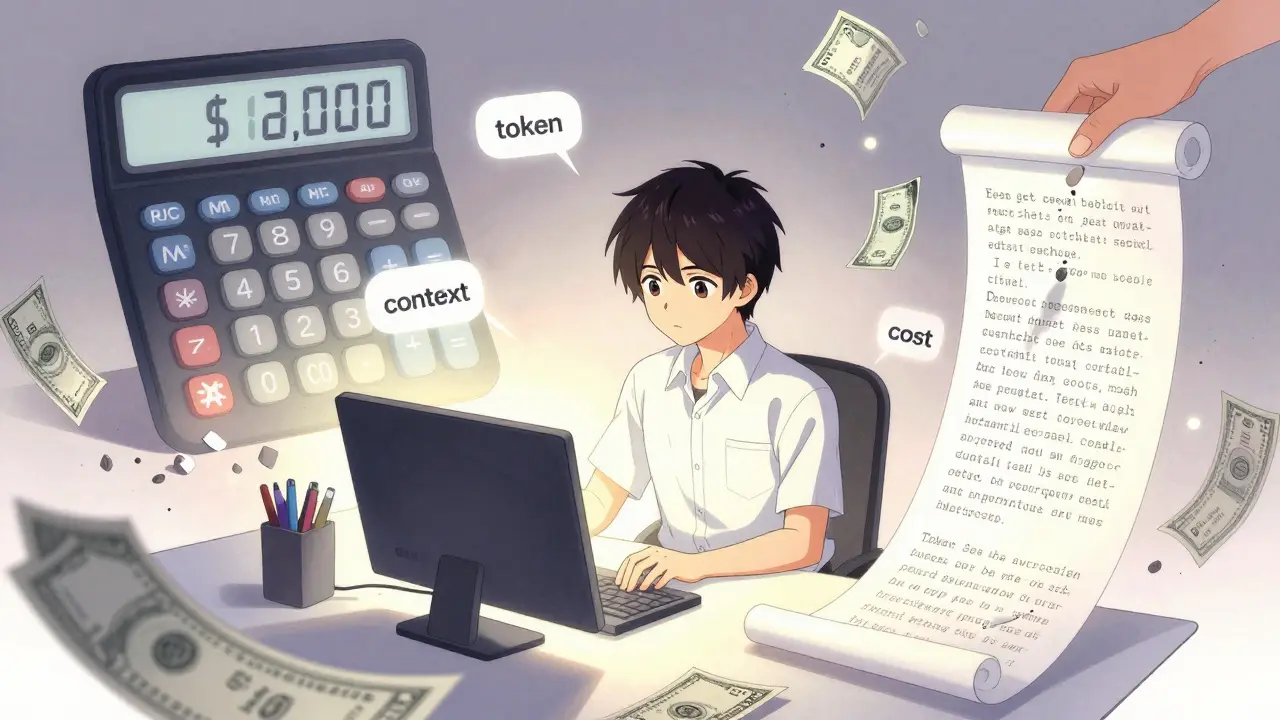

Redusere promptkostnader i generativ AI: Få mer kontekst med færre tokens

Lær hvordan du reduserer promptkostnader i generativ AI med færre tokens uten å tape kvalitet. Praktiske tips fra virkelige bedrifter som har slått ned AI-regninger med opp til 70%.

Read More