Når du skriver inn en setning i en chatbot eller spør en stor språkmodell (LLM) om hjelp med en e-post, tror du kanskje at den «tenker» på svaret. Det gjør den ikke. Den regner ut odds. Hvert eneste ord du leser fra en AI er resultatet av en kompleks sannsynlighetsberegning. Modellen ser på det du har skrevet tidligere, kikker gjennom et vokabular med titusenvis av mulige neste-ord, og velger det som har høyest statistisk sjanse for å passe.

Dette er kjernen i hvordan moderne kunstig intelligens fungerer. Det er ikke magi, det er matematikk. For å forstå hvorfor noen svar føles naturlige mens andre blir repetitive eller merkelige, må vi se under hoda på disse modellene. La oss dykke ned i mekanismen bak valgene.

Tokenisering: Språket deles opp i biter

Før modellen kan beregne sannsynlighet, må den forstå tekst. Men datamaskiner leser ikke bokstaver slik vi gjør; de leser tall. Prosessen starter med tokenisering. Når du skriver «Katten sitter på matta», deler modellen setningen opp i mindre enheter kalt tokens. Et token kan være et helt ord, en del av et ord, eller til og med et mellomrom.

Tenk deg at ordforrådet til modellen er en enorm liste over alle disse bitene. GPT-4 og lignende modeller har et vokabular på omtrent 50.000 tokens. Når modellen skal generere tekst, jobber den ikke med hele setninger på én gang. Den fokuserer kun på det neste tokenet. Dette kalles autoregressiv generering. Modellen sier i praksis: «Gitt alt jeg har sett så langt, hva er det mest sannsynlige neste steget?»

Denne metoden ble revolusjonert av arkitekturen kjent som Transformer, introdusert i papiret «Attention is All You Need» fra Google i 2017. Før Transformers brukte man n-gram-modeller som bare så på de tre eller fire foregående ordene. Med Transformers kan modellen teoretisk sett vektlegge hele konteksten - selv hvis den er tusen ord lang - når den beregner sannsynligheten for neste ord.

Sannsynlighetsfordeling: Fra logitter til valg

Når modellen har behandlet konteksten din, produserer den en liste med rå poengsummer for hvert enkelt token i sitt vokabular. Disse kalles logitter. De forteller ikke direkte hvor sannsynlig et ord er, men gir en indikasjon på styrken. For å gjøre disse tallene brukbare, går de gjennom en funksjon kalt softmax.

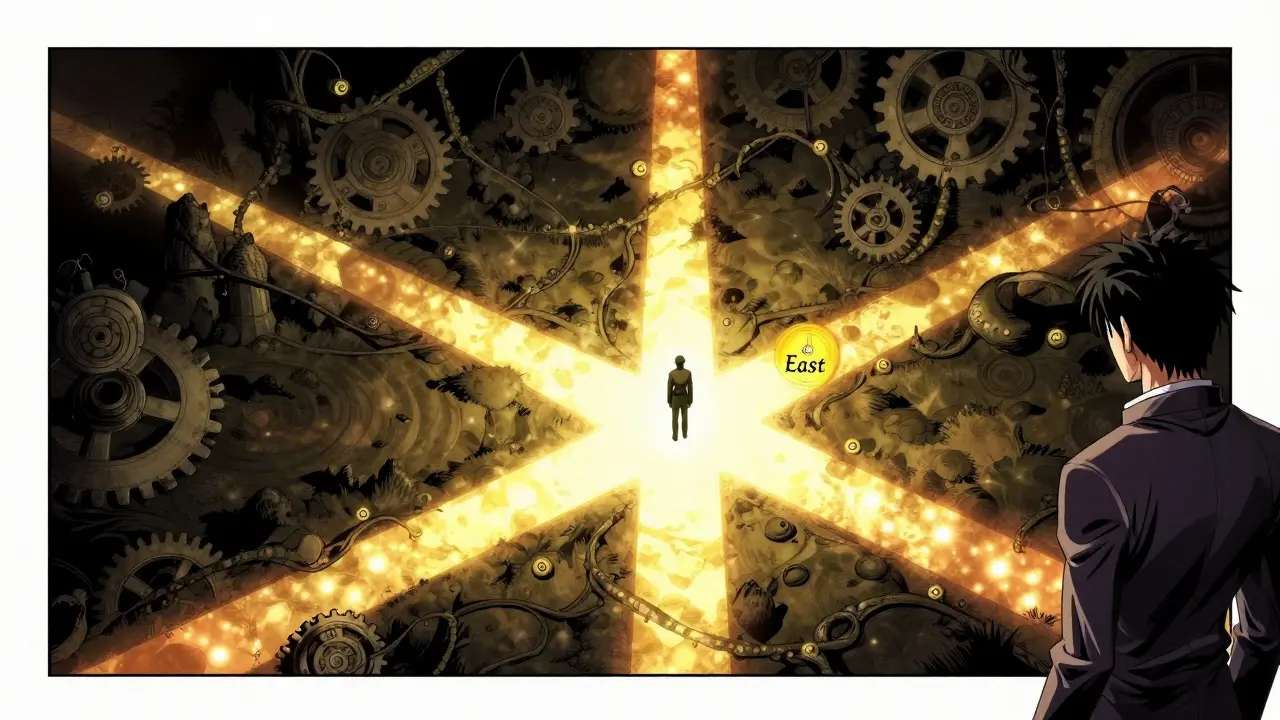

Softmax-funksjonen converterer logittene til en sannsynlighetsfordeling. Summen av alle sannsynlighetene blir lik 1 (eller 100%). La oss si at du skriver «Solen stiger i...». Modellen vil gi svært høy sannsynlighet til tokenet «øst», kanskje 0,85. Tokenet «vest» får kanskje en sannsynlighet på 0,0001, og «kjøkkenet» får kanskje 0,0000001. Modellen vet altså at «øst» er det statistisk sett beste valget basert på treningdataen sin.

Men her kommer det interessante: Modellen trenger ikke alltid å velge det mest sannsynlige ordet. Hvis den alltid gjorde det, ville teksten blitt ekstremt forutsigbar og kjedelig. Derfor har vi flere strategier for hvordan vi faktisk plukker ut det endelige ordet fra denne fordelingen.

| Strategi | Hvordan den fungerer | Beste bruk | Risiko |

|---|---|---|---|

| Greedy Decoding | Velger alltid tokenet med høyest sannsynlighet. | Kortfattede fakta, kodegenerering. | Repetitiv og stiv tekst. |

| Beam Search | Følger flere veier samtidig og velger den beste kombinasjonen. | Masjinoversettelse, strukturerede output. | Krevende beregningsmessig. |

| Top-k Sampling | Begrenser valget til de k mest sannsynlige tokenene (f.eks. topp 40). | Allment bruk, balanserer kvalitet og variasjon. | Kan ekskludere gode alternativer hvis fordelingen er flat. |

| Top-p (Nucleus) Sampling | Velger fra den minste gruppen token som tilsammen overstiger p% sannsynlighet. | Kreativ skriving, dynamisk tilpasning. | Kan bli for tilfeldig hvis p er for høyt. |

Decoding-strategier: Hvordan vi stykker tilfeldigheten

Når sannsynlighetsfordelingen er klar, må systemet ta et valg. Her kommer decoding-strategier inn i bildet. Valget av strategi avgjør stemmen og kvaliteten på AI-en.

Greedy decoding er den enkleste metoden. Modellen velger alltid ordet med høyest sannsynlighet (argmax). Dette er raskt, men ofte slitsomt å lese. Teksten kan begynne å gjenta seg selv fordi modellen faller inn i en sløyfe av de mest sannsynlige ordene. Du har kanskje sett dette før: «Det er viktig at vi forstår at det er viktig at vi forstår...»

Beam search prøver å fikse dette ved å holde flere mulige setninger oppe i løpet av hver trinn. Hvis K=3, holder modellen øye med de tre beste veiene, utvider dem, og velger den beste totalveien til slutt. Dette fungerer godt for oversettelser der nøyaktighet er kritisk, men det er beregningskrevende og kan føre til at modellen blir for forsiktig.

I dag er Top-k sampling og Top-p (nucleus) sampling standarden for de fleste chatboter. Top-k begrenser valget til de 40 mest sannsynlige ordene. Dette fjerner de absurd usannsynlige alternativene (som «banan» i en diskusjon om kvantefysikk), men lar modellen fortsatt velge blant rimelige alternativer. Top-p er smartere: den ser på formen på sannsynlighetskurven. Hvis kurven er bratt (modellens sikker), velger den fra få ord. Hvis kurven er flat (usikkerhet), velger den fra flere ord for å bevare mangfold.

Temperatur: Å justere kreativitetens dialekt

En annen nøkkelparameter er temperatur. Temperatur påvirker sannsynlighetsfordelingen før modellen velger et ord. Tenk på det som en «tilfeldighetsknapp».

- Lav temperatur (0.1-0.3): Fordelingen blir spissere. Høy-sannsynlige ord blir enda mer sannsynlige. Resultatet er konsistent, faktbasert og lite kreativt. Perfekt for kundestøtte eller kodeteknikk.

- Høy temperatur (0.7-1.0+): Fordelingen flatt ut. Sjeldne ord får større sjanse. Resultatet er mer variert, kreativt og uforutsigbart. Bra for kreativ skriving, men risikoen for hallusinasjoner (usanne utsagn) øker.

Et studie fra MIT CSAIL i 2024 viste at Top-p sampling med p=0.92 overtok andre metoder på 78% av oppgavene. Det viser at det finnes en «sweet spot» der vi balanserer mellom å følge sannsynligheten og å tillate nok frihet for naturlig språkbruk.

Begrensninger: Hvor sannsynlighet svikter

Sannsynlighetsbaserte modeller er fantastiske på etterligning, men de har blinde flekker. Dr. Percy Liang fra Stanford peker på at LLMs presterer dårlig på oppgaver som krever presis logisk resonnering. På matematiske tester som GSM8K scorer de ofte rundt 42%, sammenlignet med spesiallagde symboliske systemer som scorer over 90%.

Hvorfor? Fordi sannsynlighet handler om mønstre, ikke om sanntidlig logikk. Modellen vet at ordet «derfor» ofte følger etter en årsaksforklaring, men den «forstår» ikke nødvendigvis den logiske koblingen. Den genererer tekst som lyder riktig, selv hvis innholdet er feil. Dette fører til fenomenet «hallusinasjon», der modellen skriver selvsikre, men uriktige, fakta.

Det finnes også bias i dataene. En undersøkelse fra AssemblyAI viste at modeller har en tendens til å velge alternativ «A» i flervalgsoppgaver uavhengig av innhold, fordi tokenet «A» ofte har en litt høyere baseline-sannsynlighet i treningsdataen. Dette er en teknisk svakhet som utviklere må kompensere for.

Praktisk implementering og fremtid

Hvis du bygger en app med verktøy som Hugging Face Transformers, har du full kontroll over disse parametrene. Standardverdier er ofte temperature=1.0 og top_p=0.9. Men for en bedriftskundebot bør du senke temperaturen til 0.3 for å sikre at svarene er konsistente og trygge. For en kreativ skriveassistent kan du heve temperaturen til 0.8.

Fremtiden for LLMs ligger i å kombinere sannsynlighet med andre former for resonnering. Forskning fra IBM og Google peker mot «Neuro-Symbolic AI», der sannsynlighetsvalg valideres mot faste logiske regler eller kunnskapsgrafer. Dette kan redusere feil med opptil 37%. I tillegg ser vi adaptive systemer som justerer sine egne decoding-parametere i sanntid basert på oppgavetype.

Å forstå sannsynlighet er å forstå hjertet i AI. Det er ikke perfekt, men det er det mest effektive verktøyet vi har hittil for å la maskiner snakke menneskespråk.

Hva betyr det når en LLM «velger» et ord?

Modellen beregner en sannsynlighetsfordeling for alle mulige neste-ord basert på konteksten. Den velger ikke basert på mening eller forståelse, men basert på statistisk sannsynlighet for hvilket ord som vanligvis kommer etter de foregående ordene i treningsdataen.

Hva er forskjellen på temperatur og top-p?

Temperatur endrer formen på hele sannsynlighetsfordelingen (gjør den mer eller mindre jevn). Top-p begrenser hvilke ord som kan velges ved å kutte bort de minst sannsynlige inntil en viss prosentandel (p) av sannsynlighetsmassen er dekket. Temperatur påvirker «tilfeldigheten», mens top-p påvirker «bredden» på valgene.

Hvorfor bruker man ikke alltid greedy decoding?

Greedy decoding velger alltid det mest sannsynlige ordet. Dette fører ofte til repetitiv, stiv og unnvikende tekst fordi modellen faller inn i vanemessige språkstrukturer. Andre metoder som top-p gir mer naturlig og varierende tekst.

Kan LLMs garantere at svarene er sant?

Nei. Siden modellen baserer seg på sannsynlighet og ikke fakta-databaser, kan den generere tekst som lyder troverdig men er faktumsmessig feil (hallusinasjoner). Jo lavere sannsynlighet for et ord, jo større risiko for feil, men selv høy-sannsynlige ord kan være feil hvis treningsdataen var feil.

Hva er en token?

En token er den minste enheten modellen behandler. Det kan være et helt ord, en del av et ord (f.eks. «-ing»), eller et tegn. Modellen konverterer tekst til tall-representasjoner av disse tokenene for å kunne utføre matematiske beregninger.