Det å kjøre store språkmodeller i produksjon er dyrt. Ikke bare fordi du trenger en haug med GPU-er, men fordi hver forespørsel forbruker mye energi, tid og regnekraft. For bedrifter som vil bruke store språkmodeller (LLM) i daglig drift - for eksempel til kundeservice, dokumentanalyse eller rekruttering - er komprimering ikke lenger et valg. Det er en nødvendighet.

En komprimeringspipeline er en systematisk prosess for å gjøre en modell mindre, raskere og mer effektiv uten å tape for mye presisjon. Det er ikke bare å kjøre en enkel kode. Det handler om å kombinere flere teknikker, teste dem grundig, og integrere dem i eksisterende infrastruktur. Og det fungerer. Bedrifter som har implementert komprimering rapporterer opptil 80 % lavere driftskostnader og 10 ganger høyere inferenshastighet. Det betyr at du kan kjøre en modell på en enkel server i stedet for en hel GPU-farm.

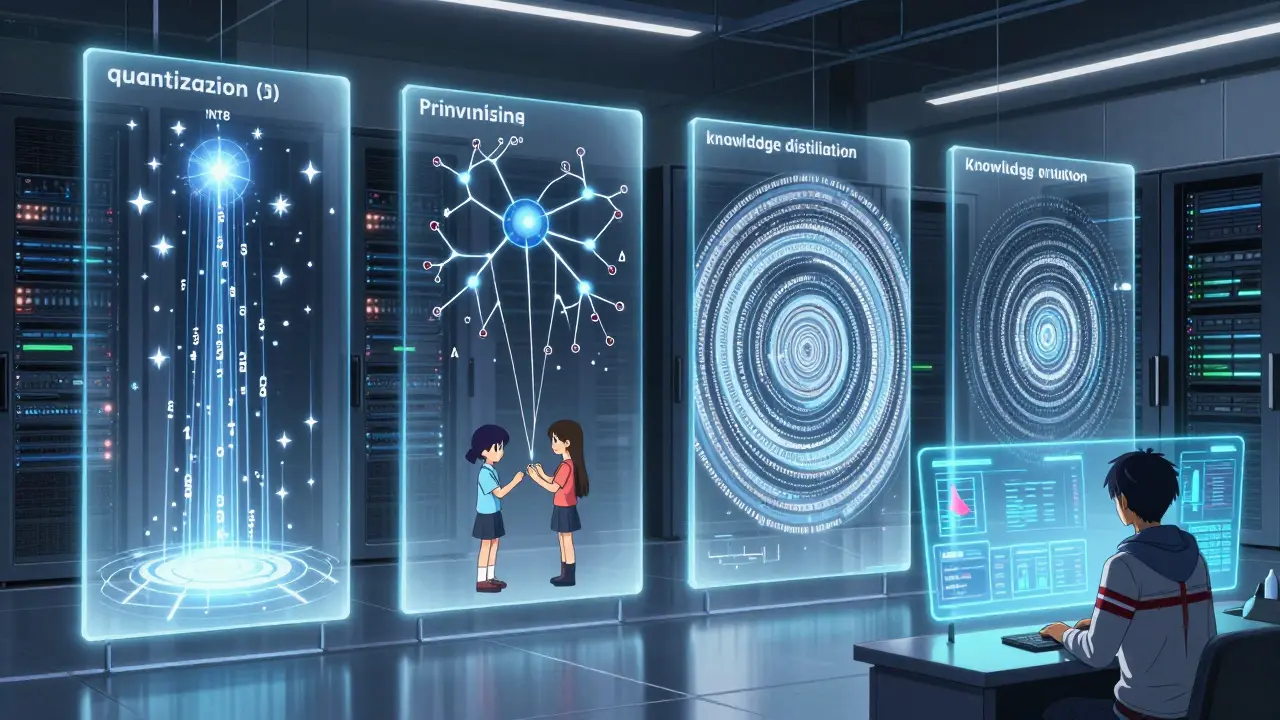

Hva er de fire hovedkomprimeringsteknikkene?

Det finnes fire hovedtilnærmingene, og hver har sine styrker og svakheter. De blir ofte brukt sammen, ikke hver for seg.

- Kvantisering: Her endrer du tallrepresentasjonen. I stedet for å bruke 32-bits flyttall (FP32), bruker du 8-bits heltall (INT8). Det reduserer minnebruket med 4 ganger og øker hastigheten med 2-4 ganger. Men hvis du går for langt - for eksempel til 4-bits - kan presisjonen synke dramatisk. Det fungerer best på generelle modeller som Llama, men er mer utfordrende for spesialiserte modeller som Mixtral.

- Pruning (utskjæring): Denne teknikken fjerner ubrukte eller reduntante vekter i modellen. Med iterative metoder kan du fjerne 80-90 % av vektene uten å tape mer enn 1-2 % nøyaktighet. Problemet? Du må finetune modellen igjen. Og det tar tid. Det er ikke bare en enkel slett. Det krever flere iterasjoner av trening og testing.

- Kunnskapsdistillasjon: Her lærer en mindre modell av en større. Du trener en liten modell (kalt student) til å gjenskape oppførselen til en stor modell (lærer). Resultatet er en modell som er mye raskere, men som beholder mye av presisjonen. Men du trenger store ressurser for å trene den store modellen først. Det er ikke praktisk hvis du bare vil deploye raskt.

- Kontekstkomprimering: Dette er ikke en modellteknikk - det er en inputteknikk. Du komprimerer forespørselen før den går inn i modellen. Det kan gjøres ved å fjerne repeterte setninger, summere opp lange tekster, eller filtrere ut uvesentlig informasjon. En pipeline som OneUptime’s ContextCompressionPipeline lar deg sette parametere som total_budget=4000 tokens og relevance_threshold=0.25. Resultatet? Du reduserer tokenbruket med 50-80 %, noe som er avgjørende for RAG-systemer der kontekstvinduet er begrenset.

Hvorfor er RAG og komprimering et perfekt par?

Retrieval-Augmented Generation (RAG) er en av de mest populære arkitekturene i enterprise-LLM. Den henter relevante dokumenter fra en database og lar modellen generere svar basert på dem. Men RAG er dyrt. Hvert søk kan involvere tusenvis av tokens - og hver token koster.

Når du kombinerer RAG med kontekstkomprimering, skjer noe magisk. En forespørsel som før var 12 000 tokens blir redusert til 3 000. Det betyr at du bruker mindre GPU-minne, får raskere svar, og reduserer kostnadene med 25-30 %. LinkedIn brukte dette til å forbedre kandidat-søk. De kompresjonerte forespørsler og fikk 30 % lavere tokenbruk - uten å miste nøyaktighet i matchingsalgoritmen.

En studie fra Second Talent viste at 60 % av alle produserte LLM-applikasjoner i 2026 bruker RAG, og 92 % av dem bruker også kontekstkomprimering. Det er ikke en tilfeldighet. Det er en strategi.

Hva er de beste verktøyene i 2026?

Det finnes mange verktøy, men bare noen har blitt vokst til å være virkelig anvendelige i produksjon.

- LLM-KICK fra Apple: Dette er den første standardiserte pipelineen som støtter kvantisering, pruning og distillasjon i én ramme. Den gir standardiserte målinger, så du kan sammenligne effekten av ulike teknikker. Det er spesielt nyttig for team som trenger å dokumentere og gjenskape resultater - noe som er påkrevd av EU AI Act fra februar 2026.

- TitanML’s Titan Takeoff Server: Designet for on-premise-deployering. Hvis du har strenge krav til dataresidens (f.eks. i finans eller helse), er dette en av de eneste løsningene som virkelig fungerer uten å sende data til skyen. Den har en 4.3/5 gjennomsnittscore fra 37 bedriftsbrukere, men mange klaget på dårlig dokumentasjon for ikke-standard modeller.

- AutoRound (i LLM Compressor): Et åpent kildekodeverktøy som fokuserer på kvantisering. Det fungerer bra med Llama-modeller, men har problemer med Mixtral og andre sparse modeller. I Q1 2026 vil de legge til støtte for flere kvantiseringsskjemaer - men det er ikke klar enda.

- DSPy: Ikke et komprimeringsverktøy i tradisjonell forstand, men et rammeverk for å automatisere forespørselsutforming. Med MIPROv2-optimiseren kan den redusere forespørselslengden med 50 % og ha en latens på bare 3.53 ms. Det er den raskeste løsningen for prompt-komprimering.

Hva er utfordringene?

Det er ikke bare å velge en teknikk og trykke på «deploy». Her er de tre største fellingene:

- Ikke-lineær oppførsel: En komprimert modell kan oppføre seg helt annerledes enn den originale. En forespørsel som fungerte før, kan nå gi en feilaktig respons. Det er ikke en bug - det er en effekt av komprimering. Debugging tar ofte 2-3 ganger lengre tid enn med en vanlig modell.

- Ulike modeller, ulike utfordringer: En modell som kan komprimeres med 90 % (f.eks. Llama) kan bare komprimeres med 50-60 % hvis den er spesialisert (f.eks. en modell for medisinsk diagnostikk). Professor Andrew Ng påpekte i november 2025 at de ofte siterte 80-90 % tallene gjelder bare generelle modeller.

- Mangler i standardisering: Det finnes ingen enkel måte å måle «hvor god» en komprimert modell er. Noen bruker BLEU, andre bruker task-specifikke metrikker. LLM-KICK prøver å endre det, men det er ikke standard ennå. Mange team har ingen måte å sammenligne effekten av to forskjellige komprimeringsstrategier.

Dr. Sarah Chen fra Stanford HAI advarte i oktober 2025: «For mye komprimering fører til irreversibel nøyaktighetstap - spesielt for oppgaver som krever logisk resonnement.» Det er ikke bare en teori. Det er en realitet i produksjon.

Hvordan starter du?

Hvis du er i et enterprise-team og skal starte med komprimering, her er en praktisk veileder:

- Start med kontekstkomprimering. Den er enklest å implementere og gir hurtige resultater. Bruk DSPy eller en enkel summarization-basert pipeline.

- Test kvantisering på en liten modell. Prøv INT8 på en Llama 3 8B modell. Mål inferenshastighet og nøyaktighet mot FP32.

- Integrer med RAG. Bruk en RAG-rammeverk som LangChain eller LlamaIndex og sett en token-begrensning på 4 000. Se hvordan det påvirker svarkvalitet.

- Sett opp en evalueringssats. Ikke bruk generiske benchmark. Lag dine egne testsett basert på virkelige brukerforespørsler fra din bedrift.

- Ikke prøv pruning før du har testet de andre. Det er den mest komplekse teknikken. Vent til du har data.

En erfaren ML-engineer fra Microsoft sa på HackerNews i januar 2026: «Jeg brukte 3 uker på å komprimerer en modell. Det var lettere enn å bygge den fra bunnen av.»

Hva kommer neste år?

Den fremtidige veien går mot dynamisk komprimering. I stedet for å komprimere modellen én gang, vil den justere seg selv basert på forespørselen.

Dextra Labs sin 2026-veileder foreslår en modell som:

- For en enkel forespørsel - bruker en liten modell uten RAG.

- For en middels kompleks forespørsel - bruker RAG med komprimert kontekst.

- For en kompleks, flertrinns forespørsel - bruker en full modell med utvidet kontekst og rekursiv resonnement.

Dette er ikke science fiction. Det er en reell arkitektur som blir testet i flere finansielle bedrifter i 2026.

McKinsey forutsier at 95 % av alle enterprise-LLM-deployeringer i 2027 vil bruke minst én komprimeringsteknikk. Grunnen? Skykostnadene er ikke lenger forsvarlige. Energiforbruket er ikke lenger akseptabelt. Og reguleringer som EU AI Act krever dokumentasjon av alle endringer - inkludert komprimering.

Komprimering er ikke lenger en teknisk kuriositet. Den er en del av grunnleggende infrastruktur. Og de som ikke starter nå, vil bli igjen.

Hva er den mest effektive komprimeringsteknikken for bedrifter?

Det avhenger av hva du trenger. Hvis du vil redusere kostnader raskt, starter du med kvantisering (INT8) og kontekstkomprimering. Hvis du har strenge krav til nøyaktighet og bruker RAG, kombinerer du kontekstkomprimering med en liten distillert modell. Pruning gir høyest komprimering, men krever mange ressurser og tid til fine-tuning. Ingen enkelt teknikk er «best» - det handler om kombinasjon.

Kan jeg komprimere alle LLM-modeller likt?

Nei. Generelle modeller som Llama 3 eller Mistral kan komprimeres med 80-90 % uten store tap. Spesialiserte modeller - for eksempel en modell trent på medisinske journaler eller juridiske dokumenter - taper for mye nøyaktighet hvis du går over 50-60 % komprimering. Det er ikke en feil i verktøyet - det er en egenskap ved modellen.

Hvorfor er EU AI Act relevant for komprimering?

EU AI Act krever at alle betydelige endringer i modellens arkitektur eller parametere dokumenteres. Komprimering - spesielt pruning og kvantisering - endrer modellen på en måte som kan påvirke dens adferd. Du må kunne vise at du har testet og dokumentert effekten av disse endringene. Uten dette, kan du ikke lovlig deployere modellen i EU.

Hva er den største feilen bedrifter gjør ved komprimering?

De tester kun på generiske benchmark-sett som MMLU eller GSM8K. Men virkelige brukerforespørsler er helt andre. En modell som klarer 95 % på MMLU kan mislykkes på 70 % av dine virkelige forespørsler. Den eneste pålitelige måten å teste på er med dine egne data - ikke med offentlige datasett.

Hvor mye tid tar det å implementere en komprimeringspipeline?

En enkel kvantisering og kontekstkomprimering kan settes opp på 1-2 uker av en erfaren ML-engineer. En full pipeline med RAG-integrasjon, fine-tuning og evaluering tar 4-6 uker. Hvis du ikke har erfaring med PyTorch, CUDA og model serving (f.eks. vLLM), kan det ta flere måneder.

Post Comments (10)

ikke glem at når du kvantiserer til int8, så kan det bli rare artefakter i svarene-spesielt hvis du har med numeriske data eller statistiske beregninger. jeg har sett modeller som plutselig starter med å skrive '3,14' som '3' og så skjønner du ikke om det er en feil eller en funksjon :/

Det er riktig at kontekstkomprimering gir rask gevinst, men det er en illusjon. Hvis du kutter bort 60 % av konteksten, så kutter du bort kontekst som kanskje var avgjørende for den logiske slutningen. Det er ikke bare et spørsmål om tokens-det er et spørsmål om mening.

har jobbet med dette i 2 år og det eneste som virkelig hjelper er å teste med virkelige forespørsler fra kundene. ingen benchmark setter deg i live. vi brukte 1200 reelle forespørsler fra kundeservice og så så vi at int8 + kontekstkomprimering ga 87 % nøyaktighet-og det var nok. start der.

llm-kick er jo gull! men dokumentasjonen er som en kryptisk norrøn saga. jeg prøvde å kjøre det på en finnmarksmodell og fikk bare 'error 42' og en emoji av en ørret. men det funket likevel. 🐟

hvor mange av dere har faktisk lest EU AI Act? det står klart at komprimering er en 'modellendring' og må dokumenteres som en 'signifikant endring'. men ingen gjør det. de bare setter opp en pipeline og sier 'det funker'. og så kommer EU og sier 'du har brutt loven' og du må stoppe alt. det er ikke en teknisk utfordring-det er en politisk bombetid.

hvis du er i helse eller finans, så er det ikke bare om å redusere kostnader-det er om å sikre at modellen ikke tar feil på en pasientdiagnose eller en kreditavslag. jeg har sett en distillert modell som ga en 'høy risiko' på en pasient som var helt frisk. det var fordi kontekstkomprimeringen slettet 'fødselsår' og 'familiehistorie'. det er ikke teknikk-det er etisk ansvar.

det er en viktig poeng at pruning krever fine-tuning, men mange glemmer at fine-tuning også må skje på en representativ data. hvis du fine-tunerer på et datasett som bare inneholder spørsmål fra 2023, så vil modellen bli dårlig på nye forespørsler. du må ha en dynamisk, oppdatert set med eksempler-ikke bare en statisk benchmark.

alle disse komprimeringsteknikkene er bare en del av en stor sammensvergelse. apple, google, og eu har satt opp en plan for å gjøre store modeller mindre slik at de kan kontrolleres bedre. men det er ikke for effektivitet-det er for å hindre at vanlige mennesker kan kjøre modeller på sine egne maskiner. du tror du sparer penger, men du blir bare avhengig av dem.

prøvde dspy i helga og det var som en magisk boks. min forespørsel på 8000 tokens ble til 1400 og svaret var bedre. jeg tror det er fordi den skjønner hva som er viktig. ikke bare kutter den bort-den velger. så kult. 😍

hvis du vil ha en god start: ta en liten modell, komprimer den med int8, sett en token-begrensning på 3000, og test med 10 virkelige forespørsler fra din bedrift. hvis den klarer 90 % av dem-da har du en løsning. ikke mer. ikke mindre. bare det.