Tag: RLHF

- May 30, 2026

- Comments 2

- Teknologi og kunstig intelligens

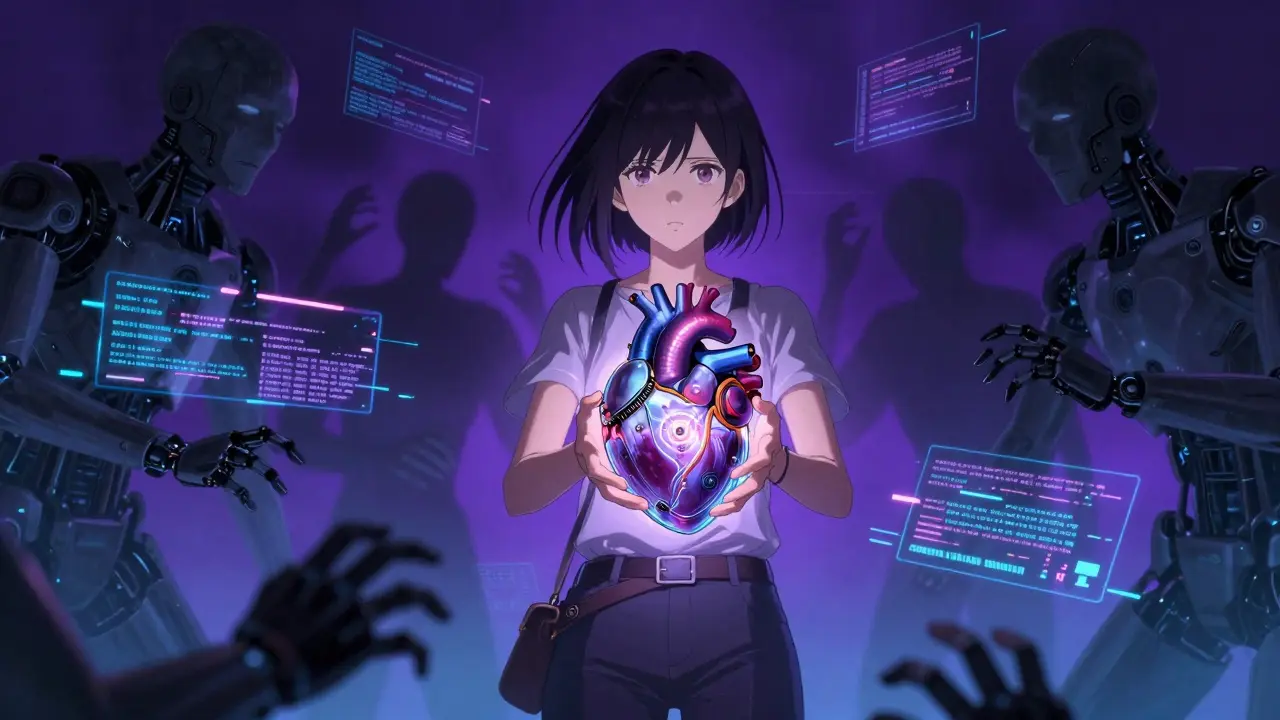

Menneskelig kontroll ved kritiske AI-beslutninger: Veiledning for 2026

Utforsk hvordan menneskelig kontroll og RLHF sikrer rettferdighet og nøyaktighet når store språkmodeller tas i bruk for kritiske beslutninger i 2026.

Read More

- May 3, 2026

- Comments 7

- Teknologi og kunstig intelligens

Kalibrering av generativ AI: Slik justerer du modellens selvtillit til å matche nøyaktighet

Lær hvordan du kalibrerer generative AI-modeller for å matche selvtillit med nøyaktighet. Vi dekker CGM-algoritmer, RLHF utfordringer og praktiske tips for å redusere hallusinasjonsrisiko.

Read More

- April 1, 2026

- Comments 9

- Teknologi og kunstig intelligens

Verdiligning i Generativ AI: Guide til Preferanstilpasning med Menneskelig Tilbakemelding

Lær hvordan preferanstilpasning (RLHF) sikrer at generativ AI agerer etter menneskelige verdier. En guide til metodene, kostnadene og alternativene.

Read More