Se for deg at du kan snakke med en maskin som ikke bare forstår ordene dine, men som faktisk ser verden slik du gjør. I årevis har vi hatt modeller som er eksperter på tekst (som GPT) og andre som er rå på bilder, men de har i stor grad snakket helt forskjellige språk. Nå er dette i ferd med å endre seg. Vision-Language Transformers er teknologien som sletter skillelinjene og skaper en felles forståelse mellom det visuelle og det språklige i én og samme arkitektur.

Hvorfor er dette så revoluserende? Fordi mennesker ikke prosesserer informasjon i siloer. Når du ser et skilt i en fremmed by, tolker hjernen din bildet av bokstavene og betydningen av ordene samtidig. Ved å forene disse modalitetene i en enkelt transformer-modell, beveger vi oss fra enkel mønstergjenkjenning til en dypere, menneskelignende forståelse av kontekst.

Hva er egentlig en Vision-Language Transformer?

For å forstå dette, må vi først se på hva en Transformer en arkitektur basert på attention-mekanismer som kan prosessere sekvenser av data uavhengig av rekkefølge er. Tradisjonelt har transformere blitt brukt til tekst, der hvert ord er et "token". Trikset med Vision-Language Transformers er å behandle bilder på nøyaktig samme måte. I stedet for å se på et bilde som en fil, bryter modellen det ned i små visuelle biter, eller "image tokens".

Når både tekst og bilder blir til tokens, kan de mates inn i den samme modellen. Dette gjør at AI-en kan utføre det vi kaller bidireksjonal generering. Det betyr at den like lett kan gå fra bilde til tekst (beskrive hva som skjer i et foto) som fra tekst til bilde (lage et maleri basert på en beskrivelse). Det er ikke lenger to forskjellige verktøy som er limt sammen, men én hjerne som forstår begge deler.

Hvordan arkitekturen fungerer i praksis

En moderne Vision-Language Model (VLM) en multimodal AI-modell som kan tolke og generere både visuell og tekstlig informasjon består vanligvis av tre hoveddeler som må jobbe i perfekt harmoni:

- Bilde-encoder: Denne delen fungerer som modellens "øyne". Den trekker ut viktige kjennetegn fra bildet, som former, farger og objekter.

- Tekst-encoder: Dette er den språklige motoren som analyserer syntaks og semantikk i teksten du skriver.

- Fusjonsmekanisme: Dette er det kritiske punktet der bilde- og tekstdataene smelter sammen. Her lærer modellen at ordet "hund" i teksten korresponderer med de spesifikke pikselmønstrene av en golden retriever i bildet.

Det finnes ulike måter å løse denne fusjonen på. Noen modeller bruker "dual-stream", hvor tekst og bilde behandles hver for seg helt til slutten. Andre bruker "single-stream", hvor dataene blandes tidlig i prosessen. Sistnevnte gir ofte en mer sømløs integrasjon fordi modellen kan utføre kryss-modal interaksjon i hvert eneste lag av nettverket.

| Strategi | Metode | Styrke | Svakhet |

|---|---|---|---|

| Dual-Encoder | Separate prosesser for tekst og bilde | Raskt for søk og matching | Svakere på kompleks resonnering |

| Fusion Encoder | Blander embeddings tidlig | Dypere forståelse av sammenheng | Krevendet regnekraft |

| Hybrid | Kombinerer begge tilnærminger | Balanse mellom fart og presisjon | Kompleks implementering |

Fra teori til virkelighet: VL-T5 og andre eksempler

Et konkret eksempel på denne teknologien er VL-T5 en modell som forener visuelle og språklige oppgaver ved å bruke tekstprefikser i en enkelt transformer . I stedet for å bygge spesialiserte modeller for hver enkelt oppgave, bruker VL-T5 tekst for å styre hva den skal gjøre. Ved å gi modellen et prefiks, kan den plutselig skifte fra å være en bildetekster til å bli en ekspert på visuelle spørsmål og svar.

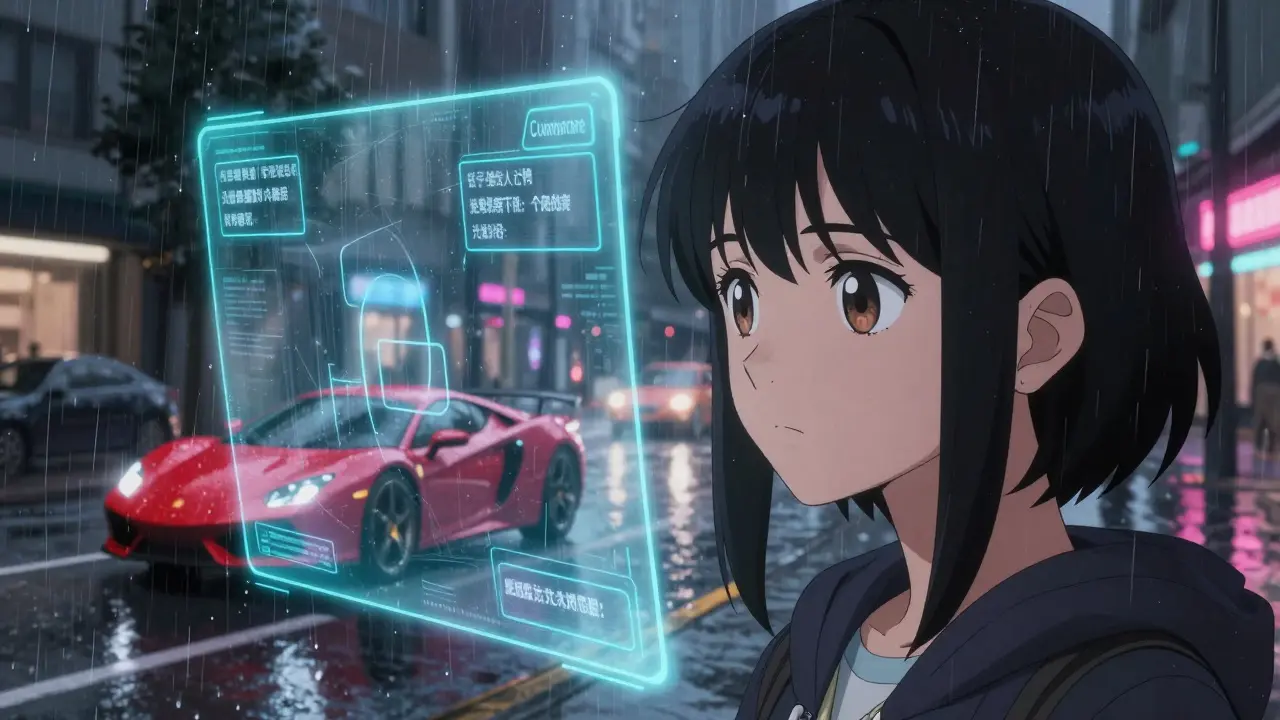

Vi ser også store fremskritt i modeller som CLIP en modell fra OpenAI som lærer visuelle konsepter fra naturlig språk . CLIP har endret spillereglene ved å trene på enorme mengder parvise bilder og tekster fra nettet. Dette gjør at modellen ikke bare vet at et bilde inneholder en "bil", men den forstår nyanser som "en rød sportsbil som kjører i regnvær i Tokyo".

Resultatene er ikke bare teoretiske. Studier på MS-COCO-datasettet har vist at forente transformere kan forbedre bilde-til-tekst generering med over 100 % sammenlignet med eldre metoder. Det er et massivt hopp i kvalitet som gjør at AI-en nå kan beskrive komplekse scener med en presisjon vi bare kunne drømme om for få år siden.

Hva kan vi faktisk bruke dette til?

Dette er ikke bare lek for forskere; det har praktiske anvendelser som endrer hvordan vi bruker teknologi i hverdagen.

Tekst-til-bilde generering er kanskje det mest synlige eksemplet. Når du skriver en prompt og får et bilde, jobber en Vision-Language Transformer i bakgrunnen for å oversette dine abstrakte ord til konkrete visuelle elementer. Dette brukes i alt fra markedsføring til konseptkunst for spill.

Bildebeskrivelse (Image Captioning) er livsviktig for universell utforming. Tenk på en person med synshemming som får en detaljert lydbeskrivelse av et bilde på nettet. Modellen analyserer bildet, identifiserer nøkkelobjekter og formulerer en naturlig setning som forklarer hva som skjer.

Visuell spørsmål-og-svar (VQA) tar dette et steg videre. Her kan du spørre: "Hvor mange mennesker på bildet har på seg blå hatter?" Modellen må da ikke bare gjenkjenne objekter, men telle dem og koble fargen blå til det spesifikke objektet "hatt".

Utfordringene vi fortsatt står overfor

Selv om fremgangen er imponerende, er det ikke uten problemer. En av de største nøttene å knekke er modalitets-alignment. Bilder og tekst har fundamentalt forskjellige statistiske egenskaper. En piksel i et bilde betyr ingenting alene, mens et ord i en setning ofte bærer mye mening. Å få disse to til å "snakke sammen» uten at den ene dominerer den andre, er en konstant balansegang.

I tillegg krever disse modellene enorme mengder data og regnekraft. Å trene en modell som skal forstå hele verden visuelt og språklig samtidig, krever datasentre som bruker enorme mengder energi. Forskerne jobber nå med mer effektive måter å trene på, for eksempel gjennom transfer learning, hvor en modell som allerede kan tekst, får "lært» å se bilder raskere.

Hva er forskjellen på en vanlig LLM og en multimodal LLM?

En vanlig Large Language Model (LLM) prosesserer kun tekst. En multimodal LLM, som bruker Vision-Language Transformers, kan ta inn flere typer data, som både bilder og tekst, og forstå sammenhengen mellom dem i sanntid.

Hvorfor bruke transformere for bilder når vi har CNN?

Convolutional Neural Networks (CNN) er supre på å finne lokale mønstre i bilder, men transformere med sin attention-mekanisme er mye bedre på å forstå globale sammenhenger i et bilde og koble disse direkte til språklige konsepter.

Er det mulig å legge til lyd i disse modellene?

Ja, absolutt. Prinsippet med å konvertere ulike datatyper til tokens kan utvides til lydbølger. Da får man en modell som kan se, høre og snakke samtidig.

Hva er en "image token"?

En image token er en representasjon av en liten del av et bilde (en patch), som er gjort om til en numerisk vektor slik at en transformer-modell kan behandle den på samme måte som et ord i en setning.

Hvor kan jeg finne åpne implementeringer av slike modeller?

Plattformer som HuggingFace og GitHub er de beste stedene for å finne forhåndstrente vekter og kildekode for multimodale transformere som CLIP og VL-T5.

Veien videre: Hva skjer nå?

Vi beveger oss mot en tid der AI ikke lenger er et verktøy vi skriver til, men en assistent som observerer verden sammen med oss. Neste steg er sannsynligvis modeller som kan resonnere i sanntid gjennom video. Tenk deg en AI som ser på at du reparerer en sykkel via kameraet ditt og gir deg instruksjoner basert på nøyaktig hva den ser i det sekundet du sliter med en skrue.

Hvis du er utvikler eller entusiast, er det nå det gjelder å utforske hvordan du kan integrere multimodale API-er i egne prosjekter. Ved å kombinere visuell forståelse med logisk resonnering, åpner vi dørene for applikasjoner som faktisk forstår konteksten i det fysiske rommet vi lever i.

Post Comments (5)

Helt enig, dette her virker jo kjempebra for folk som treng hjelp med synet!

Hahaha, sjekk på denne overforenkla forklaringa. Det er jo nesten flaut at folk tror dette er "magi" når det egentlig bare er matrise-multiplikasjon og statistisk sannsynlighet. Det er så typisk for slike artikler å ignorere den faktiske matematiske kompleksiteten bak modalitets-alignment for å få det til å høres ut som en revolusjon. Alvorlig talt, hvis du ikke skjønner forskjellen på cross-attention og self-attention, så bør du kanskje ikke engang prøve å diskutere VLM-arkitektur. Det er bare patetisk hvor lavt nivået på AI-diskusjonen har blitt i det siste, hvor folk tror at en "image token" er noe mystisk i stedet for bare en lineær projeksjon av en patch. Man må nesten ha en PhD for å i det hele tatt se gjennom dette reklame-språket. Og for ikke å snakke om energiforbruket, som blir nevnt som en "nøtt å knekke", mens det egentlig er en katastrofe av episke proporsjoner. Det er bare så utrolig pretensiøst å kalle dette for en «hjerne» når det i realiteten er en gigantisk tabell med vekter som er overfittet på internett-søppel. Jeg ler av folk som tror at dette er «menneskelignende» forståelse. Det er ingenting menneskelig over en transformer, det er bare effektiv mønstergjenkjenning på sterioder. Men ja, lykke til med å tro at AI-en din «ser» verden mens den egentlig bare regner ut neste sannsynlige token basert på et datasett fullt av feilmerkede bilder fra Flickr. Det er rett og slett tragisk.

Veldig fint forklart. Det er flott at vi bruker denne teknologien til å hjelpe folk i hverdagen, spesielt med universell utforming. Det gjør verden litt mer åpen for alle.

Tenk om vi kan koble dette til VR-briller i sanntid! 🤯 Det hadde vært helt rått å få hjelp til alt mulig mens man bare går rundt i stua 🌟

Det kommer vel bare til å bli enda mer overvåking av oss alle uansett.