Tag: distillasjon

- February 4, 2026

- Comments 8

- Teknologi og kunstig intelligens

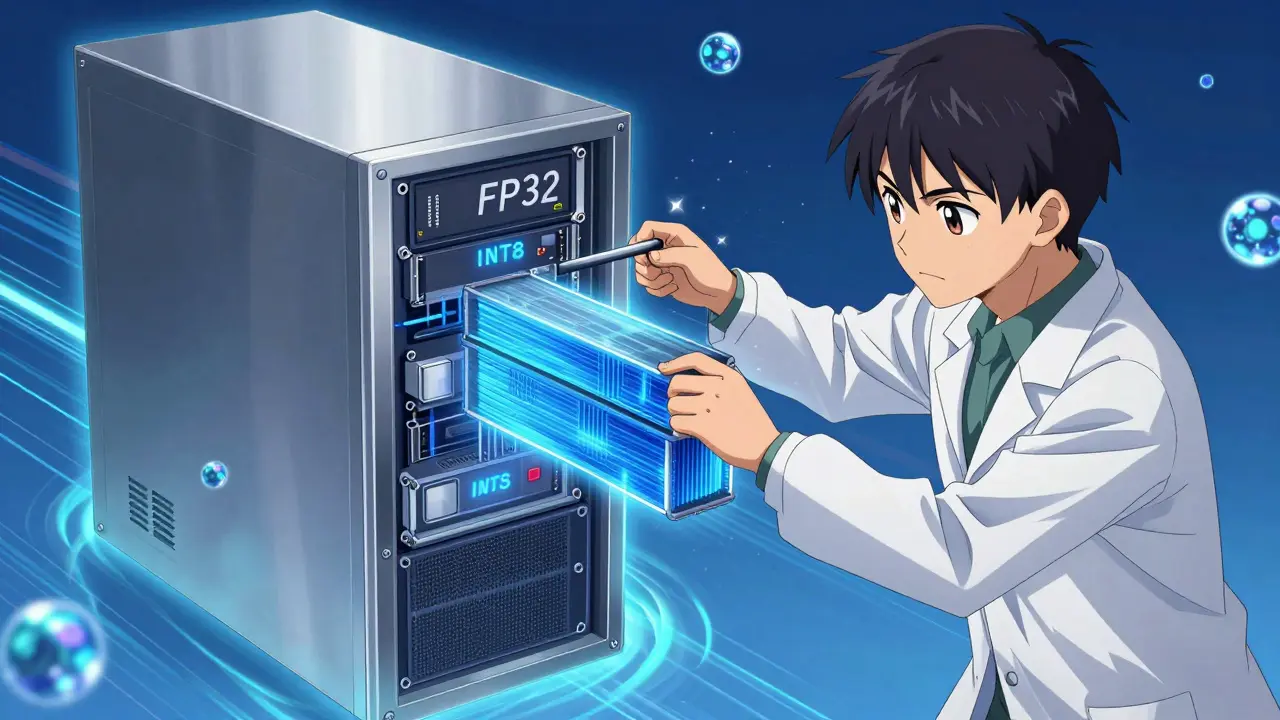

Kvantisering og distillasjon: Slik reduserer du kostnadene for store språkmodeller

Lær hvordan kvantisering og distillasjon kan redusere kostnadene for store språkmodeller med opptil 95%. Vi viser reelle eksempler, tekniske detaljer og beste praksis for å implementere disse teknikkene i produksjon.

Read More