Tag: sikkerhet i AI

- February 15, 2026

- Comments 10

- Teknologi og kunstig intelligens

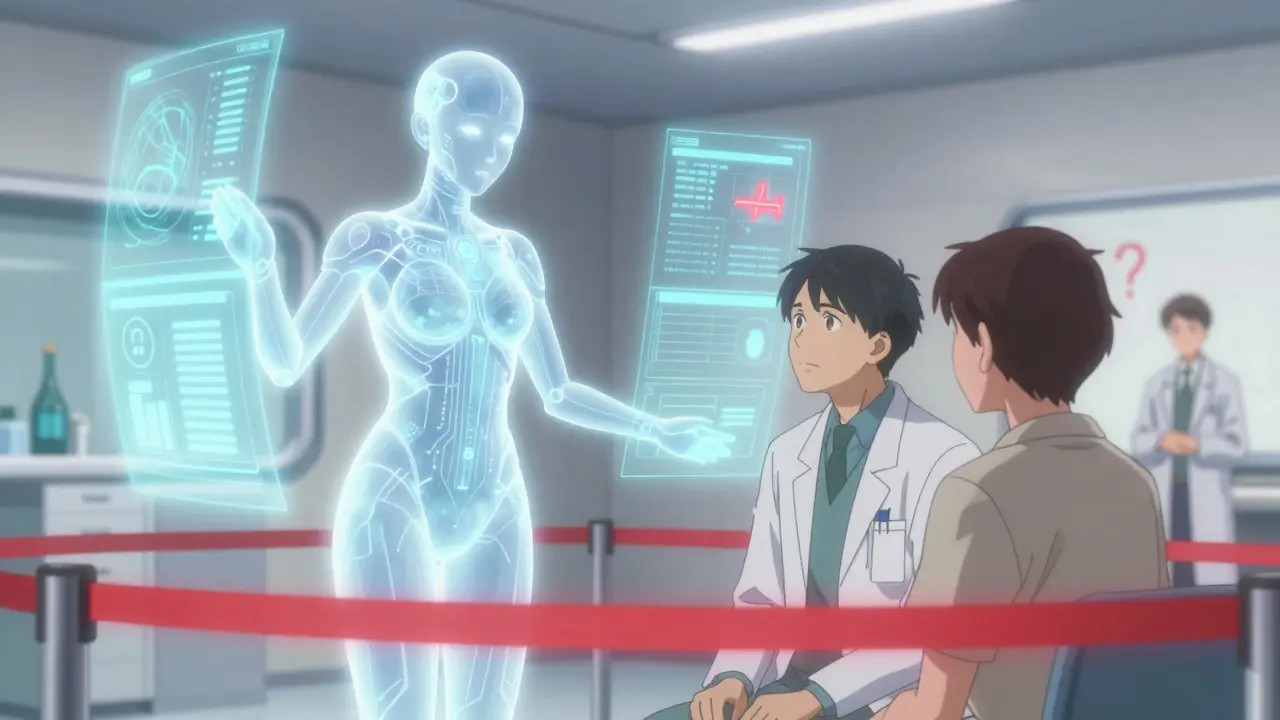

Sikkerhetsinnovasjoner i generativ AI: Kontekstuelle politikker og dynamiske grenser

I 2026 er sikkerhet i generativ AI ikke lenger en valgmulighet - det er en grunnleggende del av design. Kontekstuelle politikker og dynamiske grenser gjør AI tryggere ved å tilpasse seg brukskontekst og reagere i sanntid.

Read More