Når du vil tilpasse en stor språkmodell som LLaMA-2 eller BERT til en spesifikk oppgave - f.eks. å klassifisere kundesvar eller svare på medisinske spørsmål - trenger du ikke å trene hele modellen på nytt. Det ville ta uker, flere GPU-er, og koste en formidabel sum penger. I stedet har forskere utviklet to lette metoder som bare endrer en liten del av modellen: prompt-tuning og prefix-tuning. Begge er del av en klasse av teknikker som kalles Parameter-Efficient Fine-Tuning (PEFT), og de har blitt populære fordi de lar deg tilpasse modeller med bare 0,1 % av de totale parametrene. Det er ikke bare billigere - det er også raskere og mulig på en enkel laptop.

Hva er prompt-tuning?

Prompt-tuning legger til noen "bløte" prompt-vektorer foran inndataen. Disse vektorene er ikke ord i språket, men matematiske tall som modellen lærer å bruke. Tenk på dem som en hemmelig hint - en liten, tilpasset innledning som forteller modellen hvordan den skal tenke. Når du bruker prompt-tuning, endrer du ikke en eneste vekt i selve modellen. Du trener bare disse ekstra vektorene. De er typisk 10-100 lange, og i en modell med 7 milliarder parametre, utgjør de bare 0,1 % av alt. Det betyr at du trenger mindre minne, mindre tid, og kan kjøre det på én GPU i noen timer.

Denne metoden fungerer best når oppgaven er litt lik det modellen allerede har lært. Hvis du vil ha en modell som skriver positive anmeldelser, og den allerede er god på å skrive tekst med positiv tone, så vil prompt-tuning gjøre en god jobb. En bruker på Reddit rapporterte at han brukte 20 slike bløte prompt-vektorer for å klassifisere kundesvar, og fikk 82 % nøyaktighet. Treningen tok bare 1,2 timer på en enkelt A100 GPU. Det er enkelt å sette opp - med Hugging Face PEFT-biblioteket kan du gjøre det med 15 linjer kode. Mange brukere liker den fordi den er rask, lett å forstå, og enkel å bytte mellom ulike oppgaver.

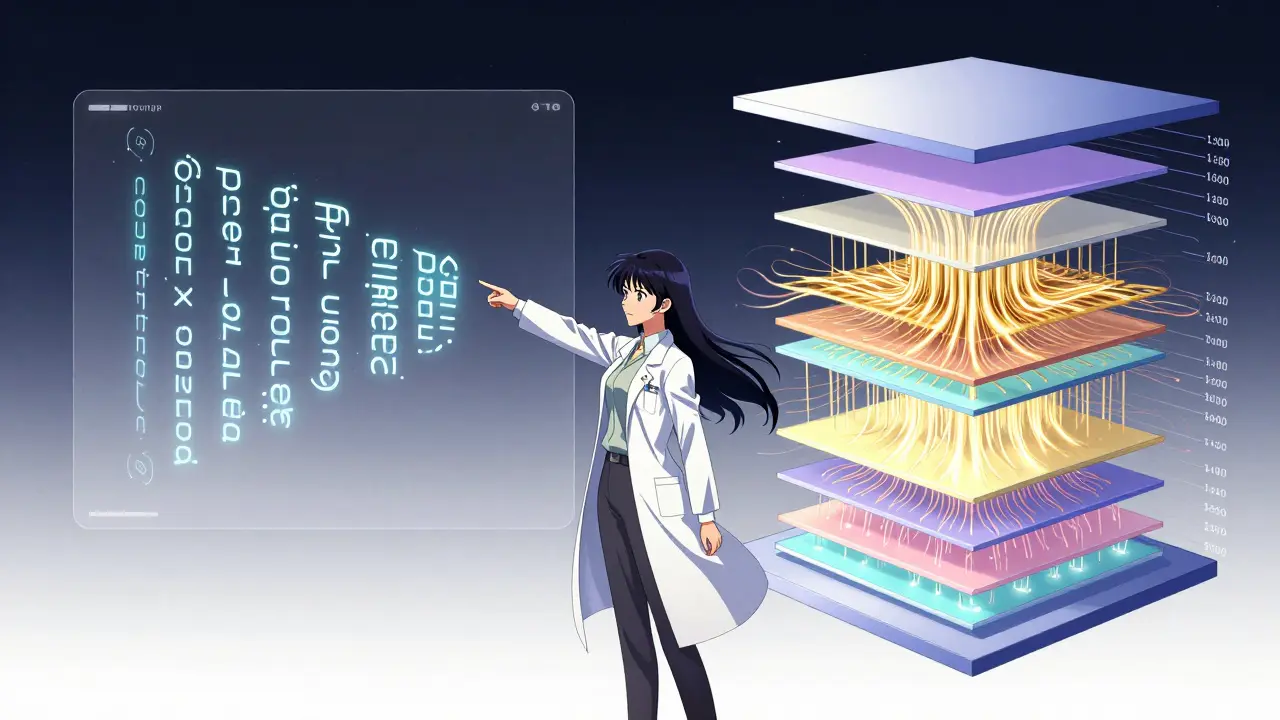

Hva er prefix-tuning?

Prefikstuning er litt mer avansert. I stedet for bare å legge til en prompt foran inndataen, legger den til små, trente vektorer i hvert lag av modellen - spesielt i attention-mekanismen. Disse vektorene virker som små hjelpere som påvirker hvordan hver del av modellen ser på ordene. Det er som å legge til små justeringer i alle hjernens avdelinger, ikke bare i inngangen. Derfor trenger den mer parametre - typisk 0,5 % til 1 % av modellen. Det er fem til ti ganger mer enn prompt-tuning, men fortsatt bare en brøkdel av hva full fine-tuning krever.

Denne metoden er bedre til vanskelige oppgaver. Hvis du trenger modellen å forstå komplekse sammenhenger - f.eks. å svare på medisinske spørsmål basert på pasienthistorikk - så gir prefix-tuning ofte bedre resultater. En bruker på Kaggle fikk 78,3 % nøyaktighet på et medisinsk QA-prosjekt med prefix-tuning, nesten like bra som full fine-tuning (79,1 %), men med 12 ganger mindre regnekraft. Det er derfor mange bedrifter velger denne metoden når nøyaktighet er viktigere enn kostnad. Hugging Face PEFT støtter den, og den har blitt brukt i produksjon av organisasjoner innen finans og helse.

Hva er forskjellen i yteevne?

Det er ikke bare et spørsmål om hvor mange parametre du trener - det handler om hvordan modellen tenker. Prompt-tuning endrer bare inputen. Den lar modellen bruke sin egen logikk, men gir den et lite hint. Prefix-tuning endrer hvordan modellen tenker i hele prosessen - den påvirker attention-mekanismen i hvert lag. Det gir større kontroll, men også større kompleksitet.

En studie fra Stanford viste at for enkle oppgaver som å sortere tall i rekkefølge, kunne begge metodene oppnå over 90 % nøyaktighet. Men når oppgaven krever en helt ny måte å tenke på - f.eks. å vurdere et ord i en kontekst som er motsatt av det den har lært - da mislyktes prefix-tuning fullstendig. Den kunne ikke lære en ny attentionsmønster. Det betyr at ingen av metodene kan overstige modellens opprinnelige forståelse. De kan bare forbedre den. Hvis modellen ikke forstår noe, så kan du ikke lære den det med disse metodene.

Hva bruker folk i praksis?

En undersøkelse fra Hugging Face i juli 2023 viste at 48 % av NLP-forskere bruker prompt-tuning, mens 32 % bruker prefix-tuning. Det er ikke fordi en er bedre - det er fordi de brukes til ulike ting.

- Prompt-tuning brukes ofte i mobile apper, chatbots, eller IoT-enheter der du trenger liten størrelse og lav forsinkelse. Den er perfekt for å bytte mellom oppgaver raskt - f.eks. en app som kan skifte mellom å svare på spørsmål om vær, reise og mat.

- Prefikstuning brukes der nøyaktighet er kritisk - i juridisk analyse, medisinsk diagnostikk, eller finansiell risikovurdering. Her er det verdt å bruke litt mer tid og ressurser for å få ekstra 3-5 % nøyaktighet.

En bruker på GitHub beskrev at han ikke kunne forstå hvorfor en bestemt prompt-tuning-konfigurasjon fungerte bedre enn en annen. Det er en vanlig utfordring. De bløte vektorene er som en "black box" - du ser resultatet, men ikke hvorfor det fungerer. Med prefix-tuning er det litt lettere å forstå hva som skjer, fordi du kan se hvilke lag som blir påvirket. Men det krever mer teknisk kunnskap.

Hvordan velge mellom dem?

Hvis du starter, og har begrenset tid eller ressurser, velg prompt-tuning. Den er enkel, rask, og gir gode resultater for oppgaver som ligner på det modellen allerede kan. Hvis du har en utfordrende oppgave, og du har tilgang til litt mer regnekraft, så prøv prefix-tuning. Den er mer kraftig, men krever litt mer erfaring.

Her er en enkel veileder:

- Har du bare én GPU og trenger rask utvikling? → Bruk prompt-tuning.

- Er oppgaven enkel og ligner på hva modellen allerede kan? → Bruk prompt-tuning.

- Har du behov for maksimal nøyaktighet? → Prøv prefix-tuning.

- Er oppgaven kompleks, og krever ny logikk? → Ingen av disse metodene vil fungere godt - da må du bruke full fine-tuning.

Det er også mulig å kombinere dem. Noen forskere kombinerer prefix-tuning med LoRA (Low-Rank Adaptation) for å få både høy nøyaktighet og lav ressursbruk. Hugging Face planlegger å legge til støtte for slike hybridmetoder i 2024.

Hva er grensene?

En viktig sannhet er at ingen av disse metodene kan lære en modell noe helt nytt. De kan bare forbedre det den allerede kan. Hvis modellen ikke forstår "hva er en diabetes" - så kan du ikke lære den det med en prompt eller et prefiks. De er ikke en erstatning for full fine-tuning. De er en smart, liten forbedring.

Det betyr at du må velge riktig modell fra starten. Hvis du bruker en modell som ikke er trent på medisinske tekst, så vil ingen prompt-tuning eller prefix-tuning gjøre den til en medisinsk ekspert. Du må starte med en modell som allerede har en god forståelse av emnet.

Hva kommer videre?

Gartner forutsier at 60 % av bedrifters LLM-bruk i 2025 vil bruke PEFT-metoder som disse. Men det er ikke bare om å bruke dem - det er om å forstå når de virker, og når de ikke gjør det. Framtiden ligger i kombinasjoner, dynamiske prefikser, og bedre forklarbarhet. Men for nå: hvis du trenger å tilpasse en stor språkmodell uten å bruke millioner av dollar - så er prompt-tuning og prefix-tuning dine beste verktøy.

Hva er forskjellen mellom prompt-tuning og prefix-tuning?

Prompt-tuning legger bare til noen trente vektorer foran inndataen og endrer ikke selve modellen. Prefix-tuning legger til trente vektorer i hvert lag av modellen, spesielt i attention-mekanismen. Det gir prefix-tuning større kontroll, men krever flere parametre og mer regnekraft.

Hvor mange parametre endres ved bruk av disse metodene?

Prompt-tuning endrer typisk 0,1 % av parametrene (f.eks. 10-100 vektorer i en 7 milliarder parameter modell). Prefix-tuning endrer 0,5-1 % - fem til ti ganger mer, men fortsatt mindre enn 1 % av hele modellen.

Kan disse metodene brukes på alle språkmodeller?

Ja, begge metodene fungerer med standard transformer-arkitekturer som BERT, GPT og T5. De er støttet gjennom Hugging Face PEFT-biblioteket, og kan brukes med modeller som LLaMA-2, Mistral og andre.

Hvorfor fungerer ikke disse metodene på alle oppgaver?

De kan ikke lære modellen nye attentionsmønstre. Hvis en oppgave krever at modellen tenker helt annerledes enn den er trent på - f.eks. å forstå et nytt begrep som ikke er i treningsdataene - så vil både prompt-tuning og prefix-tuning mislykkes. De kan bare forbedre det modellen allerede kan.

Er det bedre å bruke prompt-tuning eller prefix-tuning?

Det avhenger av oppgaven. Bruk prompt-tuning hvis du vil være rask, billig og ha en enkel løsning. Bruk prefix-tuning hvis du trenger høyere nøyaktighet og har ressurser til å trene litt lengre. De er ikke konkurrenter - de er verktøy for ulike situasjoner.

Post Comments (10)

Det er viktig å forstå at både prompt- og prefix-tuning er begrenset av modellens opprinnelige kunnskap. En modell trent på engelsk nyheter vil ikke plutselig bli en medisinsk ekspert bare fordi du legger til noen vektorer. Det er ikke magi - det er forbedring av det som allerede eksisterer. Det er en viktig forskjell fra full fine-tuning, som faktisk endrer modellens vekter. Hvis du ikke har en modell som allerede forstår domenet, så vil ingen av disse metodene hjelpe. Det er en grunnleggende misforståelse mange har.

Det er også verdt å merke seg at prefix-tuning ikke bare er 'mer parametre' - det er en mer dyp innvirkning på attention-mekanismen. Det betyr at den kan påvirke hvordan modellen kobler sammen ideer på et mer subtilt nivå. Det er ikke bare en større prompt - det er en omstrukturering av tenkning. Det forklarer hvorfor den presterer bedre på komplekse oppgaver, selv om den bruker mer ressurser.

Men det er også en ulempe: du taper forklarbarheten. Med prompt-tuning kan du se hva som skjer: du legger inn et hint. Med prefix-tuning er det som å legge inn en hemmelig kode i hver del av hjernen. Du ser resultatet, men ikke nødvendigvis hvorfor. Det gjør det vanskeligere å debugge, spesielt i produksjon.

Derfor er det ikke enkelt å si hvilken som er 'best'. Det handler om balanse: raskhet vs nøyaktighet, forklarbarhet vs ytelse. Og det handler om kontekst. En app på mobilen trenger ikke 79% nøyaktighet - den trenger 500ms svar. En diagnostisk AI trenger 79%, selv om den tar 12 timer å trene.

Vi må slutte å se disse som konkurrenter. De er komplementære verktøy. Som en saks og en hammer. Ikke alle byggeprosjekter trenger begge - men hvis du har begge, så kan du bygge mye bedre.

Det er viktig å ikke bare se på nøyaktighet. Det handler også om vedlikehold. Prompt-tuning er som en USB-stick du kan bytte ut. Prefix-tuning er som å skrive om koden i en app. Hvis du har 10 ulike oppgaver, og du må bytte mellom dem hver time, så vil prompt-tuning holde deg i live. Prefix-tuning vil kreve en ny trening hver gang.

Jeg jobber med en app som skal svare på spørsmål om reise, vær, og mat. Vi bruker prompt-tuning. Hver gang brukeren skifter språk eller tema, så laster vi en ny prompt. Det tar 0,3 sekunder. Med prefix-tuning ville det vært 30 sekunder. Det er ikke bare et spørsmål om ressurser - det er et spørsmål om brukeropplevelse.

OG: ikke glem at du trenger å overvåke drift. Hvis en prompt blir forvrengt av en feil i input, så kan du se det. Hvis en prefix blir forvrengt? Du ser bare at svarene blir rare. Og da er det for sent.