Tag: store språkmodeller - Page 2

- December 19, 2025

- Comments 5

- Teknologi og kunstig intelligens

Hvorfor store språkmodeller presterer så bra på mange oppgaver: Overføring, generalisering og fremkomne evner

Store språkmodeller presterer bra på mange oppgaver fordi de lærer gjennom overføring, generaliserer kunnskap og utvikler fremkomne evner når de blir store nok. Her forklarer vi hvordan det virker og hva som skjer bak kulissene.

Read More

- November 23, 2025

- Comments 7

- Teknologi og kunstig intelligens

Redusere hallucinasjoner med RAG: Hvordan måle effekten på store språkmodeller

RAG reduserer hallucinasjoner i store språkmodeller ved å koble dem til pålitelige kilder. Studier viser 0 % hallucinasjoner med riktige data. Her er hvordan det fungerer, hvilke tall som bekrefter det, og hvordan du implementerer det riktig.

Read More

- November 20, 2025

- Comments 7

- Teknologi og kunstig intelligens

Data Minimering i Promptdesign for Store Språkmodeller: Praktiske strategier for bedre privatliv

Lær hvordan du reduserer personlig informasjon i forespørsler til store språkmodeller uten å tape kvalitet. Praktiske strategier for GDPR-konformitet, bedre privatliv og sikrere AI-bruk.

Read More

- August 29, 2025

- Comments 8

- Teknologi og kunstig intelligens

Skaleringlover i praksis: Når skal du stoppe trening av store språkmodeller?

Skaleringlover sier når du skal stoppe trening av store språkmodeller. Men virkeligheten er annerledes. Her får du en praktisk veileder for å velge mellom teori og produksjonsbehov.

Read More

- August 13, 2025

- Comments 10

- Verktøy og plattformer

Bygge en evalueringkultur for team som bruker store språkmodeller

En god evalueringkultur for store språkmodeller sparer penger, forhindrer skade og bygger tillit. Lær hvordan du bygger den - med mennesker, mål og kultur, ikke bare automatiserte tester.

Read More

- August 1, 2025

- Comments 9

- Teknologi og kunstig intelligens

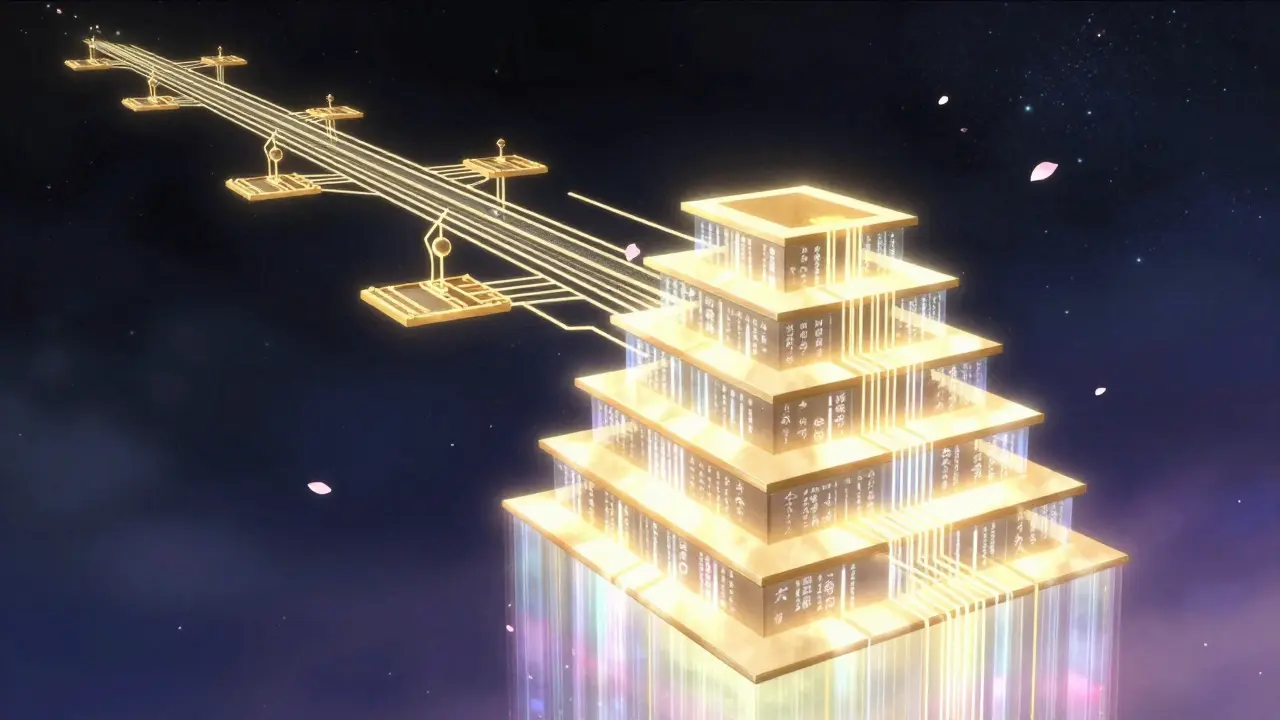

Residual Connections og Layer Normalization i Store Språkmodeller: Grunnleggende for stabil trening

Residual connections og layer normalization er nøkkelen til å trene dype store språkmodeller. Uten dem ville GPT, BERT og Llama ikke eksistert. Her forklarer vi hvordan de fungerer, hva som skiller Pre-LN fra Post-LN, og hvilke praktiske valg du må treffe.

Read More